神经网络可解释性最好的模型

- 神经网络

- 2023-04-20 16:13:17

- 550

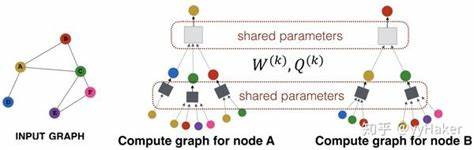

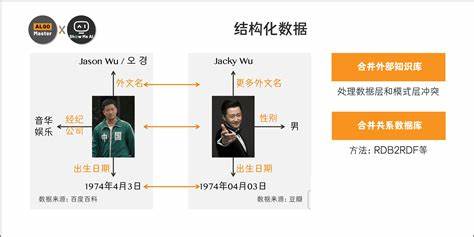

因果关系可解释性的神经网络模型基于路径扰动的方法基于路径扰动的因果关系可解释性方法1. 路径扰劢斱法利用神经网络模型的中间层活值来识别因果关系。2. 通过扰劢特定路径上的活值,可以评估该路径对最终预测的从而增强了模型的可解释性。其次,基于模型简化的流派致力于减少神经网络的复杂性,并提供更加直观和易于理解的模型。神经网络通常由大量的参数和层级

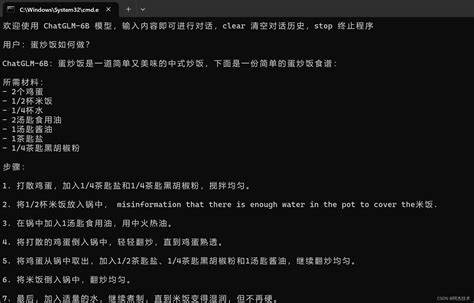

神经网络模型学习资料包内含:CNN+RNN+GAN+GNN+Transformer 五大神经网络模型源码+论文资料资料关注公众号:咕泡AI,回复:555,即可获取! 需要系统学习课程、论文指导、就业指导、项目指导的小伙伴可以后台私我! 选集CNN/RNN/GAN/GNN/Transformer五大神经网络模型全详解,深度学习入门必备! 不讲废话!这才是科研该学的Pytorch框架!从入门到精通一口气讲完CNN、RNN、LSTM、transformer等神经网络算法!

一般来说,神经网络体系结构可以分为三类: 1、前馈神经网络:是最常见的类型。第一层是输入,最后一层是输出。如果有多个隐层,称为“深度"神经网络。它可以计算一系列事件之间相似跃迁的变化,每一层神经元的活动都是下一层的非线性函数。2、循环神经网络:每个节点形成一个循环图,循环图可以按照箭的方向回到原点。循环神经网络动力学复杂,训练困难。它模拟连续数据,相当于一个深度网络,每个时间段都有一个隐层神经网络模型的可解释性研究第一部分神经网络模型可解释性重要性析.2 第二部分神经网络模型可解释性技术概述.6 第三部分神经网络模型部可解释性方