卷积神经网络在图像识别中的运用

- 神经网络

- 2024-09-20 20:49:49

- 4520

| 概念 | 描述 |

|---|---|

| 卷积神经网络(CNN) | CNN是一种特殊的神经网络,专门用于图像识别和处理。 它通过模仿类觉系统的工作原理,使用卷积层、活函数和池化层来提取图像特征。 |

| 卷积层 | 卷积层是CNN的核心,用于提取图像的部特征。 它通过移动小的过滤器(卷积核)在图像上,并计算过滤器与图像部区域的点积,从而生成特征图。 |

| 活函数 | 活函数如ReLU用于引入非线性,使网络能够学习复杂的关系。 它帮助网络捕捉到输入数据的非线性特征。 |

| 池化层 | 池化层(也称为下采样层)用于降低特征图的空间维度,减少计算量,并使特征检测更加鲁棒。 它通常使用最大池化或平均池化技术。 |

| 迁移学习 | 迁移学习是一种利用在特定任务上预训练的模型来解决新任务的方法。 在图像识别中,可以从预训练的CNN模型中提取特征,然后在新数据集上进行微调。 |

| 模型结构 | CNN模型通常由多个卷积层、活函数和池化层组成,最后通过全连接层进行分类。 ResNet、VGG和Inception是常见的CNN结构。 |

| 应用场景 | CNN在图像识别域有广泛的应用,包括脸识别、物体检测、图像分、医疗影像分析等。 |

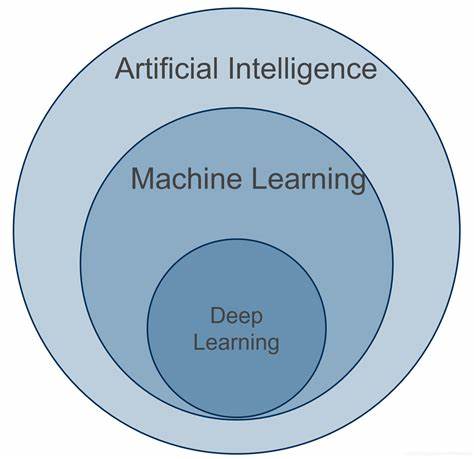

卷积神经网络(CNN)在图像识别域的应用是基于其独特的架构和设计,这些特点使其能够有效地从图像中提取特征并识别模式。 以下是对CNN在图像识别中运用的一些:

1. 部感知与平移不变性:CNN的卷积层通过部感知机自动学习图像的部特征,并且具有平移不变性,这意味着即使图像平移,网络也能正确识别特征。

2. 层次化特征提取:CNN通过层次化的结构,从较低层次提取基本的边缘、角点等特征,到较高层次提取复杂的形状和纹理特征,这种自下而上的特征提取方式有助于捕捉图像的全信息。

3. 参数共享:卷积层在处理不同图像时,使用相同的滤波器,这减少了参数数量,降低了过拟合的风险,并提高了模型的泛化能力。

4. 非线性活函数:ReLU等活函数引入了非线性,使得CNN能够学习更复杂的函数映射,从而提高模型的性能。

5. 迁移学习:CNN可以通过迁移学习来提高模型的识别能力。 通过在大量数据上预训练模型,然后在新数据集上进行微调,可以显著提高新任务的性能。

6. 优化算法:CNN的训练通常使用梯度下降或其变体,如Adam优化器,这些算法能够调整网络参数以最小化损失函数,从而提高模型性能。

7. 深度学习框架:TensorFlow、PyTorch等深度学习框架提供了构建和训练CNN的强大工具,使得研究员和开发者可以轻松实现和实验不同的CNN架构。

CNN在图像识别中的应用已经取得了显著的成果,并且随着研究的深入和技术的进步,CNN将继续在计算机觉域发挥重要作用。

上一篇:卷积神经网络图像识别用什么软件

下一篇:卷积神经网络图像识别算法