神经网络的算法有哪些

- 神经网络

- 2024-04-14 00:55:36

- 9809

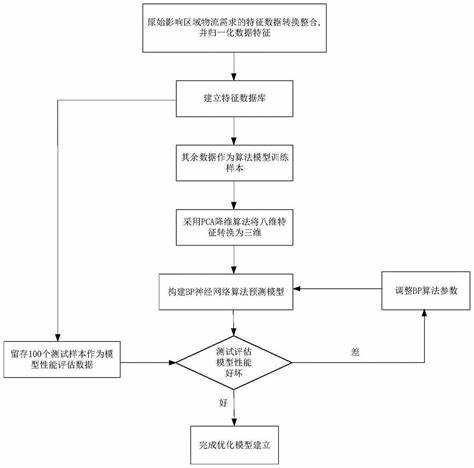

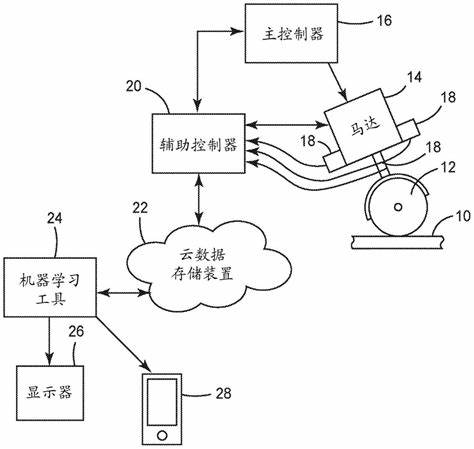

神经网络是一种机器学习算法,受到人脑神经元结构的启发。 它们由一层或多层节点(神经元)组成,这些节点相互连接并通过不同算法进行训练。

以下是一些常见的算法,用于训练神经网络:

前馈神经网络 (FNN):数据从输入层向前传播到输出层,没有反馈回路。 FNN 通常用于分类和回归任务。

卷积神经网络 (CNN):专为处理网格状数据(例如图像)而设计的,具有卷积层和池化层来提取特征。

循环神经网络 (RNN):能够记住输入序列中的信息,使其适用于自然语言处理和时间序列预测等任务。

长短期记忆网络 (LSTM):一种 RNN 变体,专门设计用于处理长期依赖性。

门控循环单元 (GRU):另一种 RNN 变体,比 LSTM 更简单、更有效,但同样适用于处理长期依赖性。

自动编码器 (AE):一种神经网络,用于学习数据的潜在表示,可用于降维、特征提取和异常检测。

生成对抗网络 (GAN):由两个神经网络组成:生成器网络和鉴别器网络。 生成器网络生成新数据,而鉴别器网络尝试区分生成的数据与真实数据。

变分自动编码器 (VAE):一种 AE 的变体,引入了随机性以学习数据的贝叶斯近似。

Transformer:一种通过注意力机制的并行处理取代递归连接的神经网络架构,适用于自然语言处理任务。

卷积 Transformer:将卷积和 Transformer 架构结合起来,适用于计算机视觉和自然语言处理任务。

神经网络算法的选择取决于问题的性质、可用数据和计算资源。 通过精心调整和优化,神经网络可以有效地解决广泛的机器学习问题。

上一篇:神经网络算法属于什么

下一篇:神经网络算法简单解析